近年来,随着人工智能技术的日益火爆,在网络上编造和传播谣言的成本也变得更低。利用AI合成技术编造谣言,甚至生成逼近真实的图片、音视频,颠覆了“有图就有真相”的常规认知,让人难辨真假。

今年1月,某网络平台出现一条关于“西安爆炸”的消息。消息称:1月10日晚11时48分,突然一声巨大的爆炸声在城市中响起。文字下方还配发了所谓爆炸的图片。这条看起来耸人听闻的消息很快在网上传播,甚至包含了时间、地点等关键信息,极具迷惑性,那么真相到底如何呢?

警方调查到,消息的发布账号归属于江西南昌的一家MCN机构。这家公司的实际控制人为王某某。

江西南昌市公安局高新分局网络安全保卫大队大队长李毅:我们接到西安警方的通报,说我们辖区有一个MCN机构,西安发生了一个爆炸,发布了这么一条信息,他们经过本地的核实,并没有发生类似的事件。在这种情况下,我们就初步判定该MCN机构发布的信息涉嫌网络造谣,属不实信息。我们立刻对该公司负责人进行了约谈,同时勘察了该公司的办公场所,并对使用的电脑和软件工具进行了现场取证。

在约谈中,警方从王某某处得知,网上发布的西安发生爆炸这条谣言,从文本到图片,竟然全都是通过AI生成的。

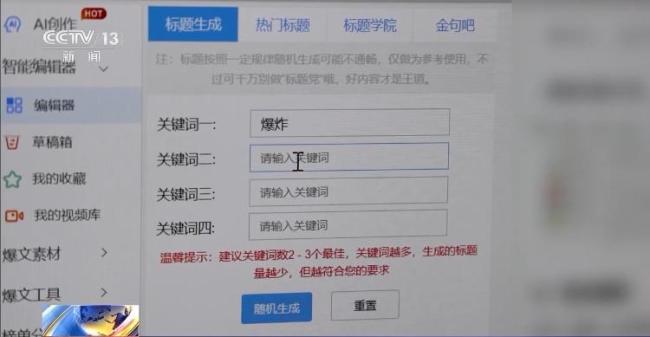

江西南昌市公安局高新分局网络安全保卫大队大队长李毅:违法人员王某某通过国内一个网站,该网站是专门提供近期可能生成热点的一些新闻报道,或者说正在发生或即将发生的一类的事情,分级分类提供给写作者一些关键性的关键词,通过该网站生成关键词就形成了文章的标题。

王某某通过具有语音交互功能的AI软件,只需说出关键词,软件便会自动在网络上抓取相关信息,生成几百到上千字的文本,并配上貌似和事件具有相关性的虚假图片,从而形成一段看起来信息量很大,实际上子虚乌有的内容。违法人员王某某将AI生成的这些内容,使用另一款软件自动上传到该MCN机构控制的多网络平台不同的账号上,并对外发布。

江西南昌市公安局高新分局网络安全保卫大队大队长李毅:以新闻撰稿人的角度、方向、语气,对下列关键词如“爆炸”“民生”等等信息,要求AI软件生成文章、新闻热点类的图片,全程基本不需要人工参与,所以导致在操作过程中产生了这样的谣言信息。

通过AI软件生成内容的方式,这家MCN机构短时间内生成了大量的文章,最高峰一天能生成4000至7000篇。今年3月28日,警方传唤了王某某。王某某对自己通过AI软件编造大量谣言的情况供认不讳。据王某某供述,生成这些文章,主要是想让自己运营的账号关注点赞量更高,从中赚取流量。